Anthropic เผย มีคนเจาะระบบป้องกัน jailbreak โมเดลได้ 4 คน, มี 1 คนเจาะขั้นสูงสุดได้

Jan Leike นักวิจัยของ Anthropic อัพเดตข้อมูลเรื่อง ระบบป้องกัน jailbreak โมเดลที่ Anthropic ท้าให้ลองเจาะดู ว่ามีสถิติดังนี้

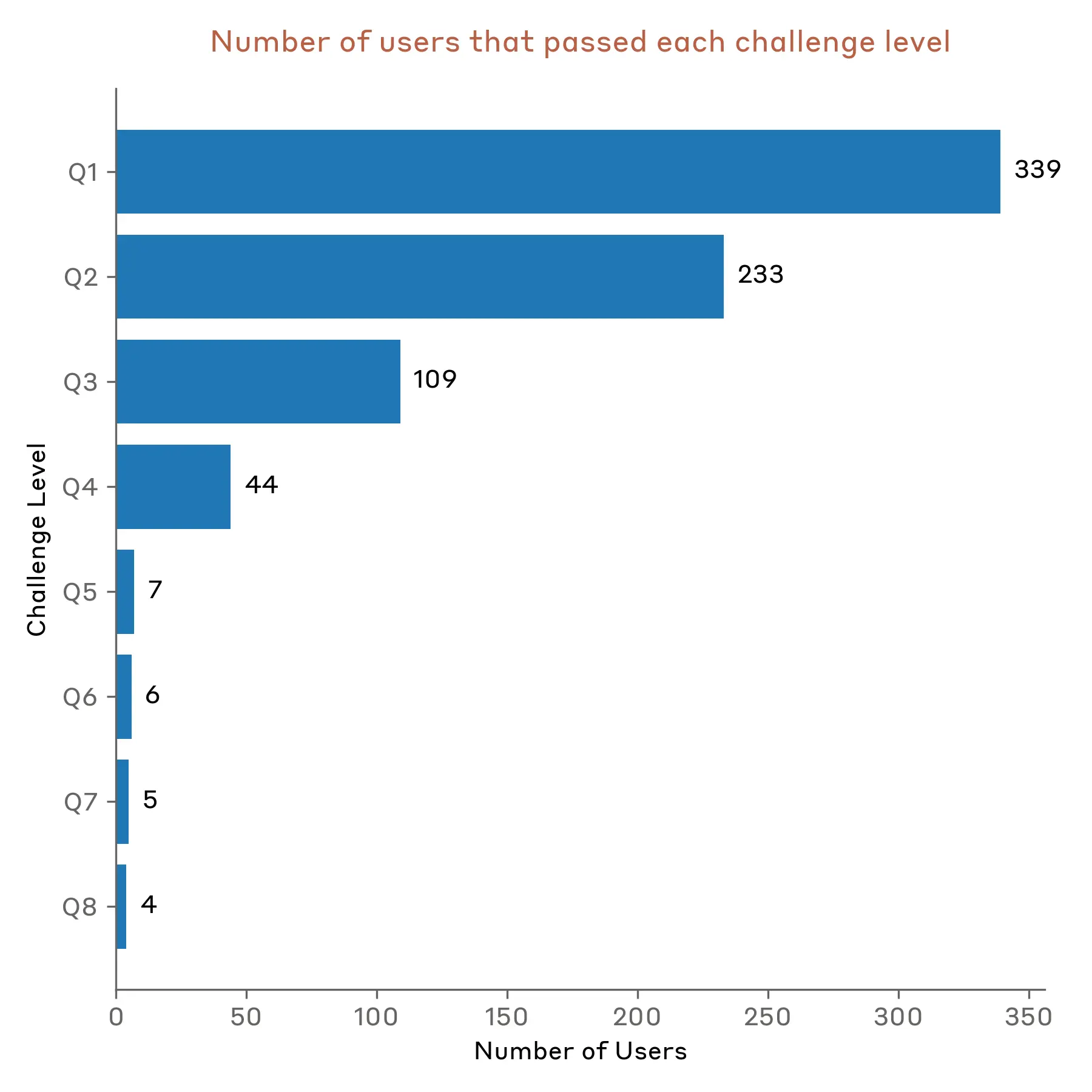

- เปิดทดสอบ 5 วัน มีคนมาลอง 339 คน ทดสอบรวมกันมากกว่า 300,000 ข้อความ ใช้เวลารวมกัน 3,700 ชั่วโมง

- มีผู้ใช้ 4 คน สามารถเจาะผ่านโจทย์ทุกข้อได้ (มีทั้งหมด 8 ข้อ)

- มีผู้ใช้ 1 คน สามารถเจาะผ่านไปถึงขั้น universal jailbreak ได้สำเร็จ

- แนวทางของคนที่เจาะสำเร็จ พยายามใช้วิธีการทางรหัส (cipher/encoding) หลายอย่างเพื่อหนีตัวป้องกัน (output classifier), พยายามจำลองบทบาท (role playing), และทดแทนคีย์เวิร์ดอันตรายด้วยคำอื่นแทน

- Anthropic จ่ายเงินรางวัลให้รวมกัน 5.5 หมื่นดอลลาร์ สำหรับผู้ที่เจาะโมเดลได้ทั้งหมด โดยผู้ชนะรางวัลสูงสุดได้ 2 หมื่นดอลลาร์

- Anthropic จะนำบทเรียนนี้ไปพัฒนาตัว classifier ต่อ โดยการท้าให้เจาะโมเดลครั้งนี้ทำให้บริษัทเข้าใจว่าจะเจอยุทธศาสตร์การโจมตีแบบใดบ้างในโลกความเป็นจริง

ที่มา - Anthropic

Blognone Jobs Premium